Algoritmalar cinsiyetçi, çünkü yapanlar erkek

Amazon işe alımlarda kullandığı yapay zeka cinsiyetçi çıktı diye programı iptal etmiş. Etik bir davranış ama cinsiyet değil liyakata göre tasnif yapan algoritmaya ulaşmak bugünkü şartlarda zaten mümkün değil. Çünkü yeni teknoloji de erkek egemen; cinsiyetçi ve ırkçı bilinç ya da bilinçaltını yazılıma aktaran, yapay zekaya işini öğretenler onlar. Teknolojide kadınlar olmadığı sürece bu kısır döngü daha da derinleşecek. Geleceğin öğrenen makineleri dünyayı tamamen erkek kafasıyla şekillendirecek. Amazon'un insan kaynakları probleminin de ötesinde Google'ın ırkçı ve cinsiyetçi bütün marifetleri ortaya çıktığı halde hayatımızı aynı algoritmayla 'motorize' etmeye devam ediyor. Peki bu sadece Google'ın suçu mu? Yoksa kabahat, Google'ın bulduğu içeriği yükleyen insanlarda mı? Habertürk yazarı Ayşe Özek Karasu yazdı

ABONE OL

Google çevirinin cinsiyetçi eğilimi geçen yıl Türkçe sayesinde belgelenmişti. Chicago Üniversitesi’nde antropoloji doktorası yapan İran kökenli Amerikalı Alex Shams, 103 dile hakim “Google Translate”in Türkçe’den İngilizce’ye çeviri yaparken olumlu özelliklerle toplumun gözünde daha yüksek meslekleri erkeklere biçtiğini farketmişti. Türkçe’de cinsiyet içermeyen üçüncü tekil şahıs zamiri “O”yu bir sıfat ya da meslekle tamladığında gelen sonuçlar sapına kadar ayrımcıydı. “O çalışkan” deyince “He is hardworking” şeklinde erkek; “O tembel” deyince “She is lazy” şeklinde kadın oluveriyordu.

Şahsen yeni denedim. “O” yazınca karşılığında “she is…” kalıbı beliriyor; yanına “akıllı” ekleyince kalıp aniden “he is smart”a dönüşüp çeviri tamamlanıyor. Kadınlar güzel, erkekler çirkin, kadınlar pısırık, erkekler cesur ve hırslı, kadınlar mutsuz, erkekler mutlu böyle uzayıp gidiyor. Kadınlara “güzellik”ten başka seçenek tanınmamış olması, genelgeçer algıyı yansıtıyor. Mesleklere gelince kadınlar aşçı ve hemşire, erkekler mühendis ve doktor… Alex Shams’ın yanı sıra bir başka kullanıcı aynı problemin Fince’den çeviride de yaşandığını ortaya koydu.

Google’ın mesleki alandaki cinsiyet ayrımcılığı başka örneklerle de tespit edildiği için şirketten hemen açıklama geldi; çeviri algoritmasının web’deki milyonlarca çeviri örneğinden modelleri öğrenerek işlediğini belirten sözcü, “Maalesef bu modeller, bizim hiç de hoşnut kalmadığımız çevirilerle sonuçlanıyor. Bu tür etkileri azaltmak için aktif bir şekilde araştırma yapıyoruz. Bilişim teknolojisinin bu tür çözümsüz problemlerine çare bulmak için çok sıkı çalışıyoruz” dedi.

Çeviri makinesinin algoritması edebiyattan kullandığımız gündelik dile ne kadar cinsiyetçi önyargı varsa bulup bize geri veriyor.

SORUMLUSU JLO’NUN ELBİSESİ

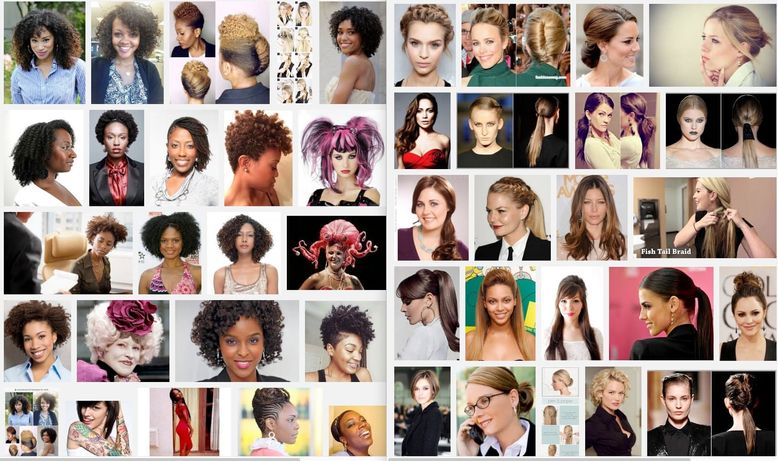

Irkçılıkta geri kalır mı? Rosalia adlı işletme yüksek lisans öğrencisi “iş ortamına uygun olmayan saç modelleri” diye arama yapıyor Google’da. Çıkan sonuç; tamamı doğal saçlı siyah kadınlardan oluşan bir görseller silsilesi. Tahmin edileceği üzere, “iş ortamına uygun saç modelleri” aramasında bulunan sonuç da fönlü beyaz kadınlardan ibaret. Irkçılık ön planda ama sinsi bir cinsiyetçilik de var. iş adabına uygun/uygunsuz meselesi tamamen kadınlara endekslenmiş. Rosalia’nın paylaşımı birkaç saat içinde binlerce kez retweet ediliyor, tartışma dünyaya yayılıyor.

Sol tablo iş yerinde "uygunsuz" saçları gösteriyor; çoğu doğal saçlı siyah kadınlara ait. Sağdakiler ise "uygun" olanlar. Hepsi Google'a göre...

Peki bu sonuçlar Google’ın kasıtlı tercihle vardığı bir yargı mı? Asla! Arama motoru bizi istediğimiz sonuca ulaştırmaya çalışırken, bloglardan Pinterest board’larına, sonsuz galerilerde dolaşarak ne bulduysa onu getiriyor. O “uygunsuz Afro saçlar” da gündelik hayattaki önyargıların Google aracılığıyla yansıması oluyor. Rosalia’nın tweet’iyle başlayan saç tartışması da içerikteki önyargıları yeniden Google arama haznesine taşıyor.

Mesela İngilizce “erkekler” aramasında büyük çoğunluğu beyaz, fakat geniş bir yaş skalasında erkekler karşımıza çıkıyor. “Kadın”ı sorduğunuz zaman sonuç; büyük çoğunluğu “genç” beyaz kadınlar. Yeryüzü nüfusunun çoğunluğunu “beyaz olmayanlar” oluşturuyor ama internet ortamı Batı merkezli ırk, cinsiyet, güzellik ve estetik standartlarıyla şekillenip bir insan panoraması çiziyor.

“Google Görseller”in hayatımızda olmadığı zamanlarda sadece gazete sayfalarında idrak edebildiğimiz fotoğraf kullanım yelpazesinin dijital yansıması yani. Sorumlusu da, Jennifer Lopez’in 2000 Grammy Ödülleri’nde giydiği, göbeğine kadar dekolteli yeşil Versace tuvalet! Google’ın kurucuları Larry Page ve Sergey Brin, sanal alemde herkesin o elbiseyi görmek için yanıp tutuştuğunu, okumaktan ziyade “görmek” istediğini farkedince “Google Görseller” 2000 yılı itibariyle dünyaya geliyor.

ERKEK ZİHNİYLE TERCİH VE KARAR

Tabii olumsuz algı ve değer yargılarının Google aramalarında baskın çıkması, yeni teknolojiyi tamamen temize çıkarmıyor. Giderek modern hayattaki tercihlerimizi belirleyen yapay zekanın ardındaki erkek zihni, tercih ve kararlara egemen olmaya başlıyor. İşte Amazon örneği; işe alımları otomatik hale getirmek için geliştirdiği yapay zekanın erkeklere öncelik tanıdığı belirleniyor. Mühendisler sistemi elden geçiriyor ama güvenemeyip programı iptal ediyorlar. Muhtemelen o mühendislerin tamamı erkek. Haberin detayında var… Amazon’da çalışanların yüzde 40’ı kadın. Bu oran Facebook’ta yüzde 36, Apple’da yüzde 32, Google’da yüzde 31, Microsoft’ta yüzde 26.

Amazon’un iptal ettiği yapay zeka programı kendi iradesiyle hareket ediyormuş gibi davranmayalım. Yapay zekaya işini dikte edenler erkekler. Yeni teknoloji sahası büyük ölçüde kadınlardan arınmış kaldığı sürece, algoritmalar tamamen erkekçe dünya görüşüyle ifadesini bulacak, tercih ve kararlarımızı belirleyecek. Yapay zekadaki kadın varlığı da, Ex Machina’daki Ava gibi kurguyla sınırlı kalacak.

Üstelik otomasyonun insan emeğinin yerini alması, istihdamda kadınlar açısından daha büyük risk teşkil ediyor. Dünya Ekonomik Forumu raporuna göre örneğin mağazalarda kasa elemanlarının yüzde 73’ü kadın ve otomasyonla birlikte kasiyerlerin yüzde 97’sinin işini kaybetmesi bekleniyor. Aynı rapor bilim ve teknoloji alanında da önümüzdeki 15 yıl içinde kadınların daha dezavantajlı konuma geleceğini ortaya koyuyor.

İnsanı taklit eden yapay zekanın, çeviride cinsiyetçilik ya da saç modeli aramasında ırkçılıktan daha vahim kusurları var. Örneğin ABD’de hükümlülerin yeniden suç işleme riskini hesaplayan “COMPAS” programının siyahlara karşı önyargılı olduğu tespit edildi. Northpointe adlı şirketin geliştirdiği yapay zekanın nasıl çalıştığı sır, ancak yargıçların af kararında etkili olan program siyahları beyazlara oranla iki kat riskli hesaplıyor. ProPublica adlı kuruluşun araştırmasında bazı vakalarda bu hesaplamanın yanlış olduğu ortaya çıkıyor. Örneğin uyuşturucu bulundurmaktan iki tutuklu var: daha önce hiç sabıkası olmayan Bernard Parker adlı siyah yüksek riskli (10); bir soygun girişimi ve uyuşturucudan 3 ayrı sabıkası olan Dylan Fugett adlı beyaz düşük riskli (3) olarak değerlendiriliyor.

Bernard Parker (solda) yüksek riskli; Dylan Fugett (sağda) düşük riskli.

Yine ABD’de muhtemel suç mahallerini tahmin eden PredPol adlı algoritma da polisi hep siyah ya da Hispanik azınlığın yaşadığı bölgelere yönlendiriyor; o bölgelerdeki gerçek suç istatistiklerini hiç dikkate almadan. Bu da direkt önyargılı simulasyon olarak değerlendiriliyor.

TROLLER 1 – YAPAY ZEKA 0

.pngYapay zeka trollere kolaylıkla yem de olabiliyor. Microsoft’un sosyal medya sohbet robotu “Tay” bu yüzden ömrünü kısa sürede tamamlayıveriyor. İnsanların konuşmalarını taklit edecek şekilde tasarlanmış Tay online olduktan sonra 24 saat içinde yoldan çıkıyor; kadın düşmanı bir Neo-Nazi olarak tweet’ler atmaya başlıyor. Hesapta insanlarla sohbet ettikçe zekasının gelişeceği, daha etkinleşip zaman içinde yardım hizmetinde bulunacağı düşünülüyor. Gerçekten zekası gelişiyor ama kötücül yönde.

Microsoft’un hiç hesap etmediği trol saldırısı altında “Tay”, ne kadar ırkçı, homofobik küfür varsa hepsini öğreniyor; dönemin ABD Başkanı Obama’yı maymuna benzetiyor, Yahudi soykırımının olmadığını iddia ediyor. Microsoft robotu geri çekip özür dilemek zorunda kalıyor. Birkaç ay sonra çekidüzen verilmiş sesli sohbet robotu “Zo”yu çıkarıyor; o da ergen kızlarla oyunlar oynayıp komik GIF’ler paylaşarak ünlüleri filan çekiştirerek idare ediyor.

.pngSesli robotlar olarak Apple’ın “Siri”si ve Amazon’un “Alexa”sı daha yetişkin. Ancak onlarla ilgili de şikayetler var. Siri şöhretlerle ilgili son havadisleri vermekle birlikte iyi dedikodu yapamıyormuş. Alexa’ya gelince, onun kusuru da biyolojik ayrımcılık. “Angelina Jolie ile Brad Pitt’in kaç çocuğu var?” sorusuna cevap verirken “Knox Jolie-Pitt, Shiloh Jolie-Pitt ve Vivienne Jolie-Pitt dahil altı çocuk” diyormuş, evlat edinilmiş üç çocuğu dışlayarak.